股票配资知识

股票配资知识

文┃小夏

编辑┃叙言

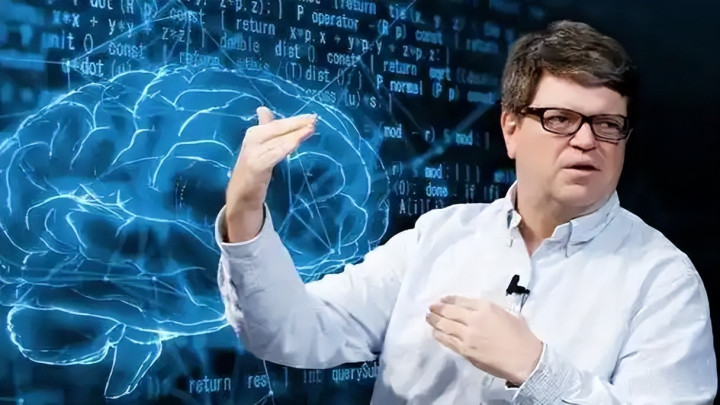

近日,图灵奖得主、前Meta首席AI科学家YannLeCun在一档访谈里炸了锅。

他直言不讳地说,现在硅谷追捧的大语言模型路线就是胡扯,根本走不通。

更让人意外的是,已经65岁的他,刚结束在Meta长达12年的工作,选择重新创业,要靠一套“世界模型”改写AI的未来。

大佬叛出Meta,只为打破封闭

LeCun离开Meta的决定,并非一时兴起。

他在访谈里提到,以前像他做的这类长期基础研究,只能靠IBM、贝尔实验室这种大企业,或是Meta、谷歌的研究院支撑。

本来他推动的开放研究还影响过整个领域,可后来包括Meta在内的很多实验室都转向了封闭。

这种封闭氛围对基础研究太不友好了。

LeCun就吐槽过,要是不让科学家发表成果,只让他们闷头搞研究,还得等好几年才能看到产品影响,没人能有足够动力做真正有用的事。

而且内部追捧的项目,很可能只是自我感觉良好,没经过学界检验根本靠不住。

无奈之下,他才选择在65岁这个本该退休的年纪创业。

他的新公司AMI,核心就是要坚持开放研究。

本来想在Meta内部继续推进自己的研究方向,后来发现实在行不通,创业反而成了唯一的出路。

炮轰LLM神话,AI该先过“狗关”

LeCun对当下的LLM热潮,批评得相当直接。

他觉得业界对大语言模型规模化的执念,把AI引上了一条看似高速、实则封闭的死胡同。

在他看来,现在AI最大的瓶颈不是怎么逼近人类级智能,而是先达到“狗的智能水平”,这个判断确实颠覆了很多人的认知。

毕竟现在大家都盯着LLM的语言能力和知识覆盖面,可LeCun认为,现实世界的理解、预测和行动能力,远比生成流畅文本复杂得多。

LLM本质上只是在复述记忆的内容,根本没真正理解世界。

我倒觉得这个观点挺有道理,就像现在的LLM处理图像、视频这些数据时,效果总是差强人意。

本来想靠增大参数规模解决这个问题,后来发现根本行不通。

这些连续、高维的噪声数据,和文本数据的逻辑完全不同,LLM根本驾驭不了。

世界模型是什么?不玩像素玩抽象

LeCun押注的“世界模型”,和大家想的可能不一样。

很多人以为世界模型是像《星际迷航》里的全息甲板那样,复刻现实世界的每一个细节,但LeCun说,这是个错误的想法。

真正的世界模型,核心是在抽象表征空间里建模世界规律,简单说,就是过滤掉那些没用的细节,只预测和任务相关的部分。

比如想知道100年后木星在哪,根本不用知道木星的全部信息,只要六个关键数据就够了,这个思路不是凭空来的。

LeCun在这个方向已经研究了近20年。

从1993年提出的对比学习模型,到后来的BarlowTwins、VICReg,再到现在的JEPA架构,核心都是为了让模型学会这种抽象表征。

他还提到,之前整个领域都犯过一个错,就是试图在像素级别做预测,这在视频这种高维空间里几乎不可能实现。

直到放弃像素级预测,转向抽象表征,才找到正确的方向。

65岁再出发,为AI找对方向

很多人都好奇,LeCun已经拿过图灵奖,荣誉满身,为什么65岁还要折腾创业?他自己的答案是使命感。

在他看来,提升世界上的“智能总量”是件内在正确的事。

智能是这个世界上最稀缺、最需要的资源,不管是帮人类变聪明,还是用机器增强人类智能,都是在做同一件有意义的事。

他还提到,硅谷现在的竞争太激烈,所有公司都被迫做同一件事,形成了技术单一化的氛围。

这种环境下,很容易被不同方向的技术突破颠覆,他之所以选择跳出硅谷,在巴黎、纽约等地布局新公司,就是想打破这种僵局。

对于AI的未来,LeCun也有自己的判断,他觉得“通用智能”这个概念本身就站不住脚,人类智能其实也是高度专用化的。

与其追求通用智能,不如追求“人类水平智能”,也就是让机器在人类擅长的领域达到或超过人类水平。

最乐观的情况下,5到10年内可能会出现接近“狗水平”的智能系统,但这只是最理想的估计,AI发展中总会出现新的瓶颈。

至于大家担心的AI安全问题,LeCun认为不用暂停发展,而是要在设计阶段就加入硬性约束。

比如让家用机器人始终避开人类,限制危险动作,这种先天的安全设计,比事后微调LLM过滤内容靠谱多了。

LeCun的反叛,给当下火热的AI行业泼了一盆冷水,现在的AI行业确实有点陷入LLM的路径依赖。

对于整个行业来说,多一条探索路径,总比所有人挤在一条死胡同里强。

毕竟,真正的AI进步,从来不是靠跟风内卷,而是靠这种敢于质疑、勇于探索的精神。

声明:本文内容均是根据权威材料,结合个人观点撰写的原创内容,辛苦各位看官支持,请知悉。

股票配资知识

股票配资知识

恒信证券提示:文章来自网络,不代表本站观点。